中村啓氏インタビュー 前編

ドーム(プラネタリウム)などの特殊大型スクリーンを中心に、アニメ、ゲーム、プロジェクションマッピング、企業PV、CMなど映像製作でも多方面に渡って活躍されている中村啓氏に前後半に分けてお話を伺いました。

中村啓

なかむら けい

山梨県出身

TVアニメ、ゲーム、プロジェクションマッピング、企業VP、CMなどの多方面でフリーランスとして活躍され、現在はドーム(プラネタリウム)などの特殊大型スクリーンやVRの映像製作を中心に幅広い分野で活動されています。

鳴海アラタ様の描かれた原作の漫画、「10000光年双眼鏡」をプラネタリウム映像として製作され話題に、2021年7月27日に開催されたLightWave 3D クリエイターズ

ウェビナー Vol.3 「プラネタリウム映像 「10000光年双眼鏡」メイキングセミナーで、ドーム(プラネタリウム)映像を製作する上でのチップスやテクニックを前半と後半の二部構成で惜しみなく語っていただきました。

本ウェビナーに向けて、LightWave 3D クリエイターズ ウェビナー Vol.3 「プラネタリウム映像 「10000光年双眼鏡」メイキングセミナーの紹介動画を作成いただきました。

自己紹介をお願いいたします。

中村啓と申します。

会社員時代はゲーム開発を行っておりましたが、現在は映像のフリーランス業を営んでいます。以前はドーム以外でも仕事をしていましたが、現在は大型特殊スクリーン系が中心になります。とはいえ、今でも機会が許す限り、様々な分野での仕事に積極的に取り組んでいます。

LightWave 3Dを使い始めたきっかけを教えてください。

学生時代に趣味でゲームを作っていて、そのゲームに入れるムービーを作りたくて3DCGを始めました。最初は六角大王やRayDreamStudioと言ったツールでしたが、次第にやりたいことが増えてきたため、当時評価が高かったLightwave v5.6 Windows学生版を買ったのがきっかけです。

購入以来の長い付き合いとなるのですが、フリーになってしばらくは色々な所へ出向し、様々な環境で仕事をし、LightWave v9 の頃は一時的にLightWave から離れて他のツールに移っていました。

その後、個人ベースの自営業に戻り、またLightWave を使うようになったのですが、LightWave から離れた期間があったことで、その良さを再発見したり、客観的に違う理解をすることが出来たと感じています。

中村様が制作された作品や携わった作品等を教えていただけますでしょうか?

大きく分けて平面の映像作品と、円筒形やドーム型など特殊な画面に投影する映像とがあります。

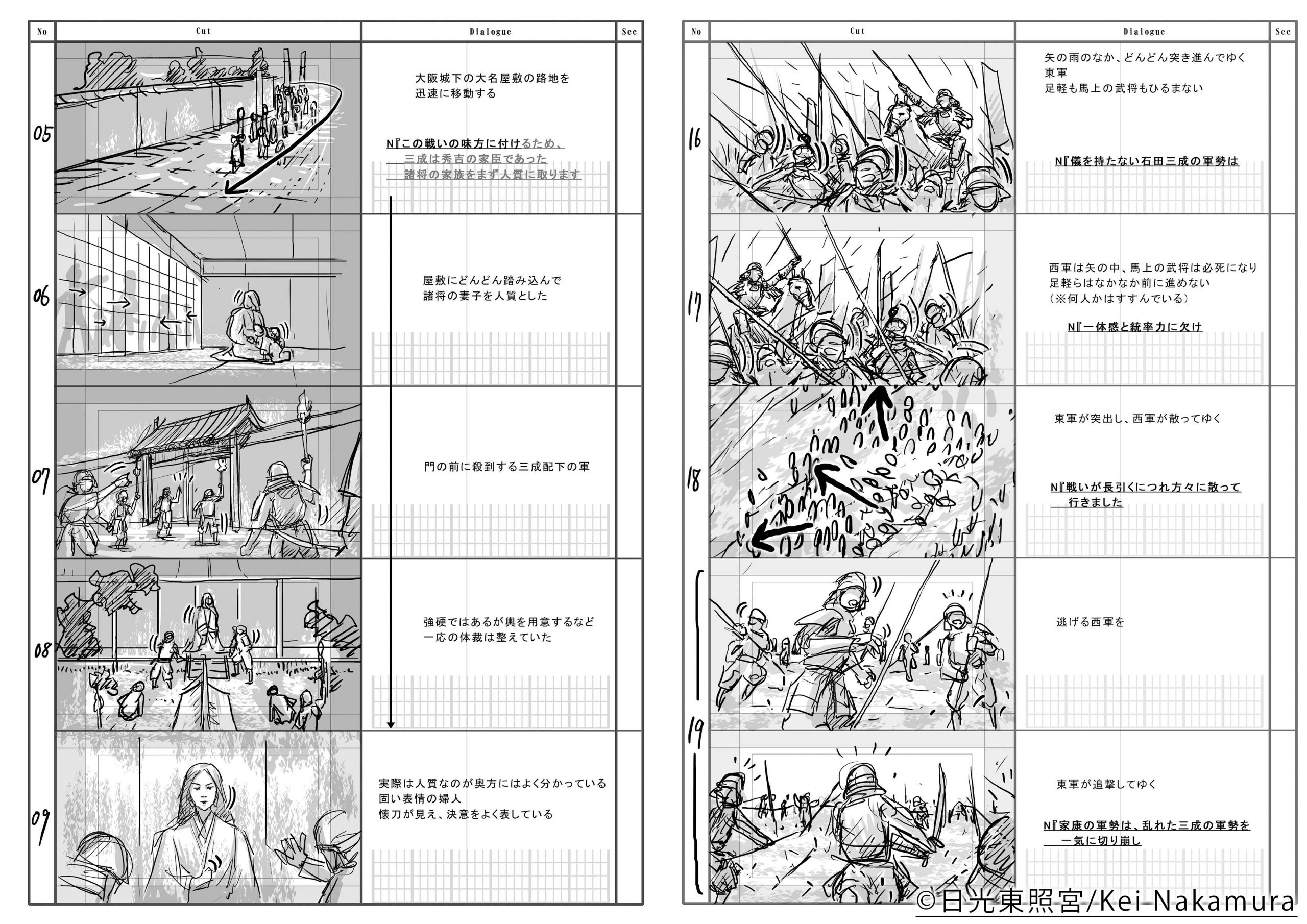

平面系では「メタルギアソリッド2 バンドデシネ」、NHKの「リトル・チャロ」、日光東照宮の宝物館で上映されている警察博物館の「僕は鼻のそうさかん」という短編アニメーションなどです。

特殊画面系では、2016年のNHK紅白の「椎名林檎」さんのプロジェクションマッピングの映像、横浜みなとみらいの三菱みなとみらい技術館の円筒スクリーンの映像などです。

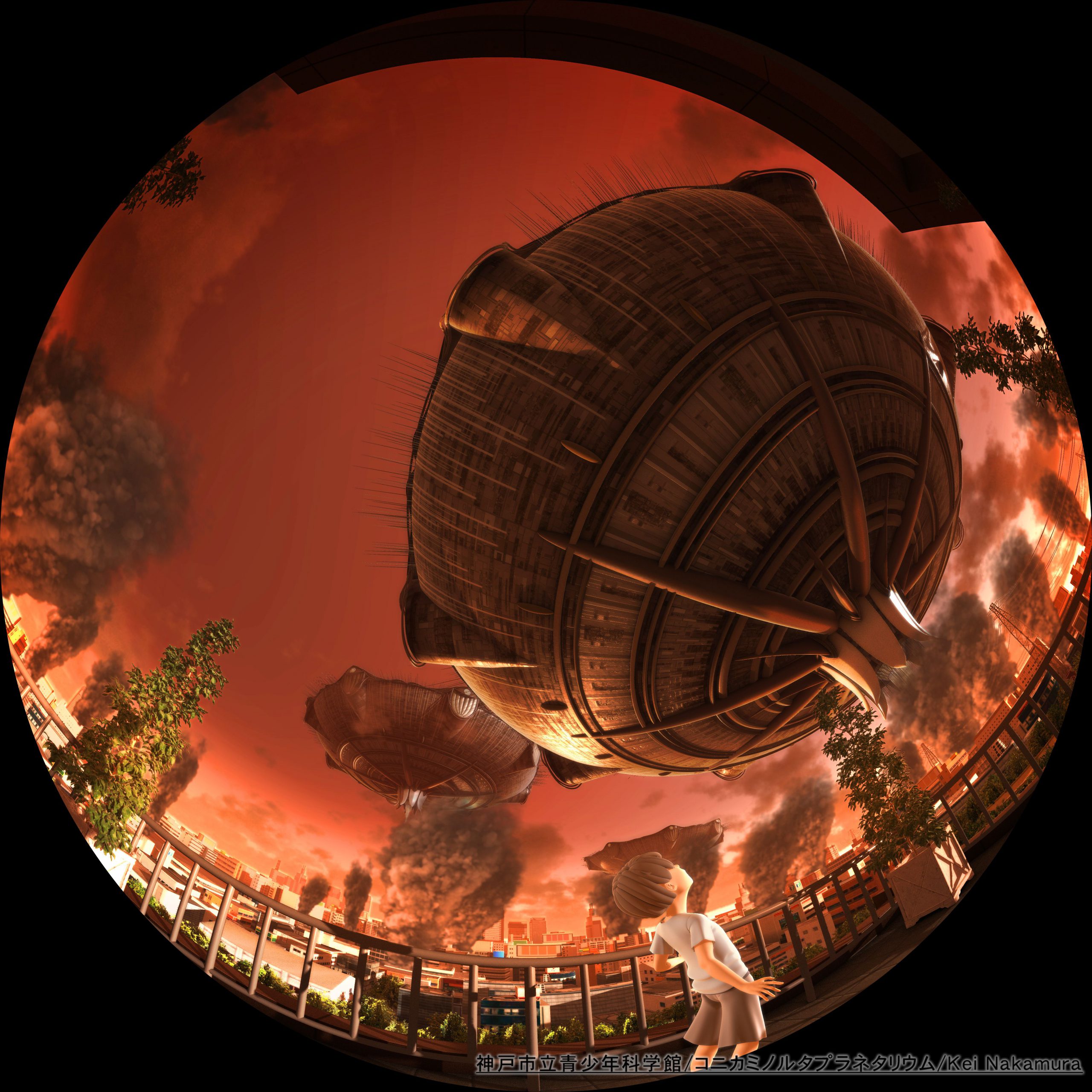

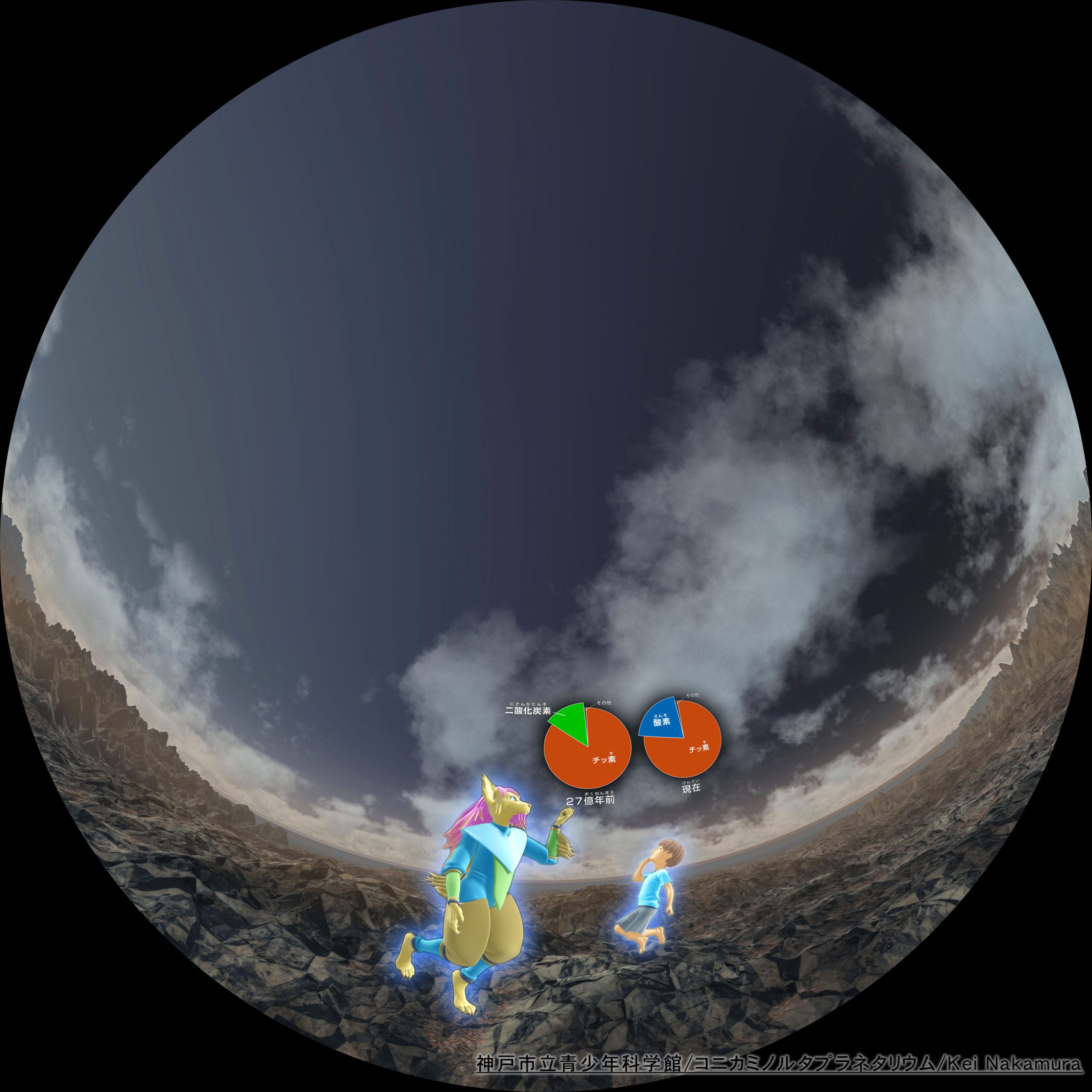

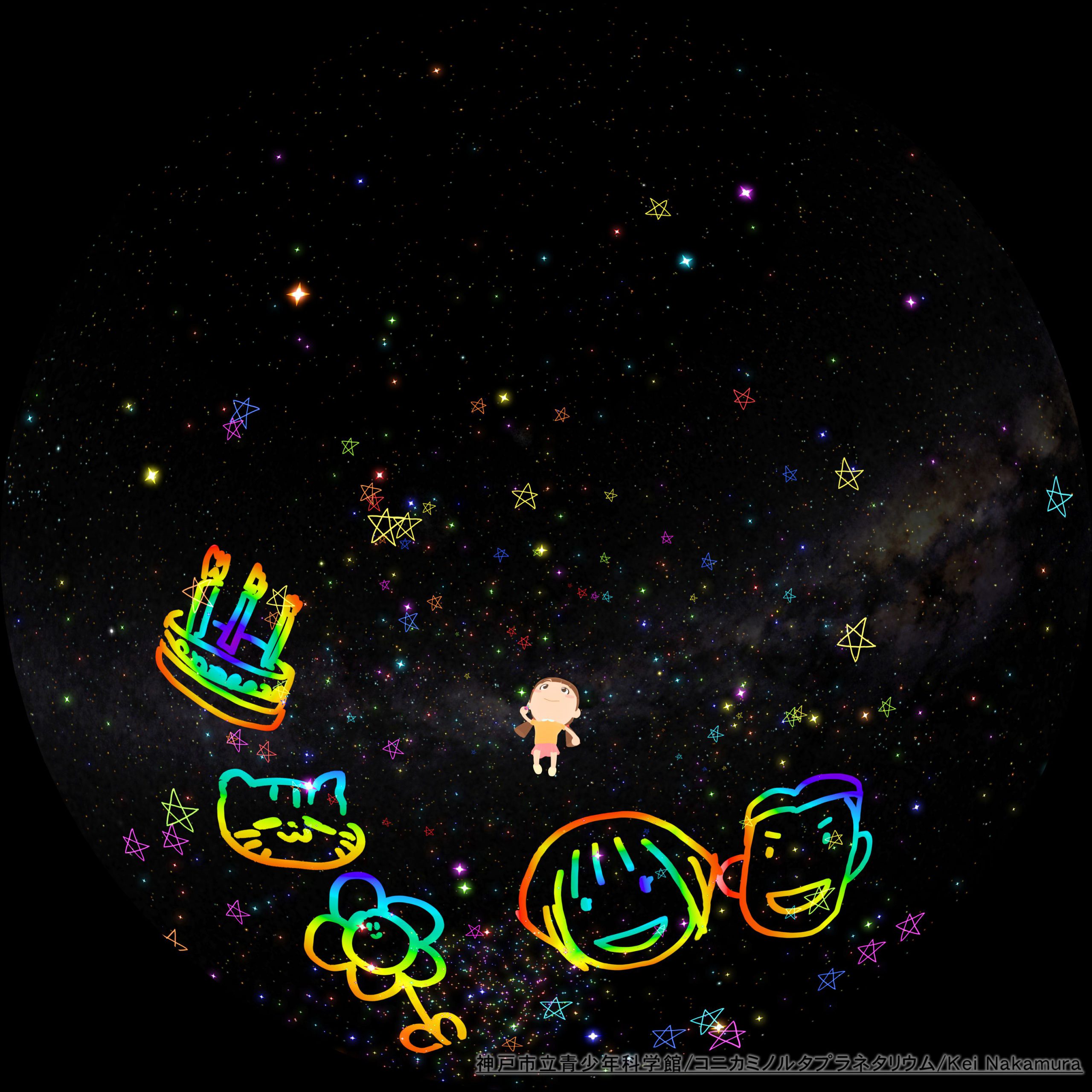

プラネタリウムに関しては、本当に多く、現在は毎年2~3本くらいのペースで作っています。昨年は、「彼方のエイリアン」と「彩ちゃんと夜空のキャンバス」という30分の映像を作りました。

あとは自主制作となるドーム作品「高く、遠くへ―」を手掛けています。

中村様はドーム映像制作の先駆者と勝手に思っているのですが、ドーム映像の制作で苦労された点や工夫されている点を教えていただけますでしょうか?

プラネタリウムなどのドーム系や天文に関して私は後進です。先駆者として他にすごい方が大勢いらっしゃいます。そういう方々と真正面から競っても簡単に負けてしまう、それくらい天体に対しての蓄積や再現力に差を感じます。でもそれはそれで良いと思っていて、私の強みは違うところにあると最近は感じています。

例えば映像の演出だったり、地上と人間の描き方といった、少し脇の違う部分が今の私に求められているのではないかという印象を持っています。

平面映像とドーム映像の大きな違いとして「視野が人間の視界以上か以下か」というのがあります。ドーム映像では「アップカットが存在しない」、「平面合成が非常に難しい」という特性もあります。板をポンポンポンと配置して、画を作っていくということが非常に難しいです。

距離と体積も正直に表現されます。例えば、この素材は何メートル先にあるな…ということが視聴者に伝わってしまいます。VR映像と同じ方向性です。そこがドーム映像の大変な所かなと思っています。

他には、仕上げた映像をドームに投影すると、PCモニタと画の印象が大きく変わります。映像を壁に映した時にドーム内で光の乱反射が発生することが主な原因になるのですが、これはどんなに経験を積んでも結果が予測できないです。明るい部屋でプロジェクターを映す現象と似ています。

制作時には途中でテスト投影を行う機会があります。深夜10時か11時などに、関係者だけで行うのですが、毎回帰る時にガックリ肩を落として帰っています。いまだに体得できません。

ドームは、最低でも解像度が2K、最高で8Kです。まだ経験したことがありませんが、16Kもあると聞いた事があります。このように大きい解像度の世界なので、総制作時間、レンダリングに用いる時間は常に最大の問題となります。ある程度融通の効くプロジェクトでは、工期全体の約1/2が過ぎたぐらいの時点で、仮完成を考慮して時間を計算するようにしています。

テスト投影をしている最中に修正ポイントとか分かるものなのですか?

さすがに数を作ってくると、ある程度こう調整すれば望む画になるな…と分かるようになるのですが、ただそれでも想定通りにはならないです。多分、ドーム関係者全員が同じことを感じていると思います。

中村様は作品内容によってLightWaveと3DSMAXを切り分けていると伺っていますが、どのような場面で切り分けていますでしょうか?

例えば LightWave が主になるプロジェクトである場合、3ds Max はもっぱらキャラクタアニメーションに用います。なぜかというと総制作時間の関係で、ゼロからリグを仕込む時間が用意できないのです。3ds Max はキャラクタスタジオやCATとか、キャラクタアニメーションに必要な機能があらかじめ入っていたりするので、そこを利用しています。

3ds Max が主になる案件の場合でも、モデリングはほぼ LightWave です。切り分けというか、常に相互補完の関係があると思ってもらって良いと思います。

あとは外部の制作会社との連携の問題であったり、レンダリングの負荷も判断の基準になります。さきほど言った1枚をレンダリングするのにかかる時間を考え、望む結果が得られない場合、ツールごと切り替えて作り直すこともあります。

各ツールで出来ること、出来ないことが比較的はっきりしているので、それで担当を決めることもあります。一つのカット内であっても素材ごとに違うツールで受け持つこともあります。星空だけ LightWave で作って、その他の部分は 3ds Max で作るとか、そういう感じです。

LightWave と 3ds Max間のデータの受け渡しってどうやっているか教えていただけますでしょうか?

FBXで受け渡ししています。受け渡し時に想定外の問題が発生する場合があるので、バージョンを変えて何パターンかテスト出力します。

コンポジットは何を使っていますか?

アフターエフェクツを使っています。ドーム映像のドームマスターではアフターエフェクトは不可欠なのです。自分の場合はポスト合成を多用しますのでその理由もあります。

作品によって変わってくるかと思いますが、制作のワークフローを教えていただけますでしょうか?

平面の場合はまずコンテを描きますが、自分はものすごく細かく描く性格なので、コンテが組み上がった時点で作品としての姿が出来上がっています。平面の場合はそこに依存して押し切る感じです。

ドームの場合は、驚かれるかもしれませんが、プロジェクト上、コンテが存在しないことがあるんです。ドームの見え方はコンテとしてとして描くのは難しいのです。ですので自分の裁量が効く場合は、必ず最初にドーム想定でコンテを描くようにしています。コンテがある!と驚かれた経験もあります。

コンテの後にはすべてデフォルトサーフェイスの灰色の球やボックスのオブジェクトをバンバン配置して、解像度を1K(1024*1024)の10fpsの状態で30分尺の分をすべて確保して動画コンテ化します。これを行うことで、ドーム投影の際に大体の空間の感じがつかめるので、そこから修正できるところを出します。

その後は、LightWave では「オブジェクトの置き換え」と10fpsを30fpsに引き伸ばす「フレームの伸長」です。完パケに持っていくまでに絶対必要となるのが、この2箇所。「オブジェクトの置き換え」も「フレームの伸長」も LightWave は滅法強いので、大抵のケースではこの方式で成立します。

「10000光年双眼鏡」に関しては、この動画コンテの方法が当てはまらなかった非常に珍しいケースです。

コンテを描いている時に工数とか分かってしまうのですか?

描きながら決めています。ここはこれが必要だなとか、これは要らないなとか。自作業の特殊性だと思いますが、コンテを描く時に、どう作れば良いかという道筋は、大体見えて来ます。

制作についてお聞きします。制作の流れとしては、最初にデフォルトサーフェイスの灰色データを用意し、その後簡単なモデルデータを作ってからアニメーションをつけ、最後に本番用のデータに置き換えるといった流れになりますか?

自分は中間データ(簡単なモデルデータ)は作らず、デフォルトサーフェイスのデータで作って、置き換えて調整していくという感じだと思います。中間データを用意しないことで、時短しています。

続く…

後編では10000光年双眼鏡についてお話を伺いました。